在今天的年度搜索活动中,谷歌谈到了今年晚些时候谷歌搜索的几项新功能。此外,该公司还展示了Google Lens的新功能,该功能利用机器学习和增强现实技术来提供更无缝的实时翻译体验。

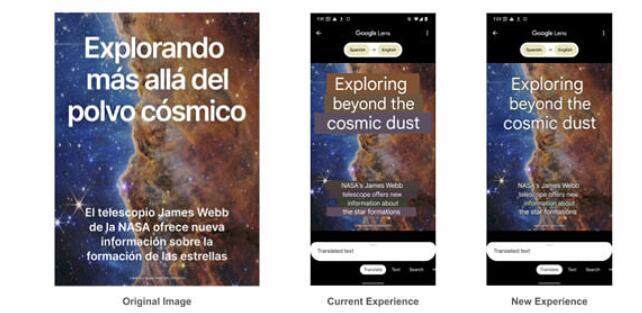

谷歌镜头已经为实时翻译提供了一段时间的支持。但是,在当前状态下,该功能会覆盖原始图像以显示翻译后的文本,使其外观丑陋。通过更新的谷歌镜头AR翻译体验,谷歌旨在使实时翻译看起来更加自然和无缝。

正如您在附图中看到的那样,新的 Lens AR 翻译体验不会在原始图像上显示任何难看的条形。这是因为它利用机器学习来擦除原始文本,使用AI生成的背景重新创建下面的像素,然后将翻译后的文本覆盖在顶部。生成的图像看起来更加无缝。

虽然这种新体验似乎会减慢谷歌镜头的实时翻译速度,但谷歌向我们保证不会。该公司声称,该功能使用优化的机器学习模型来擦除原始文本,重新创建背景,并在短短100毫秒内覆盖翻译后的文本。谷歌使用生成对抗网络(又名GAN模型)来实现这一壮举,这与为Pixel设备上的魔术橡皮擦功能提供支持的技术相同。

可悲的是,您将不得不等待一段时间才能尝试新的镜头AR翻译体验。谷歌表示,该体验将在今年晚些时候向用户推出,但该公司尚未提供明确的发布时间表。目前,目前还不清楚这种新体验是否会在所有平台上的Google Lens上提供。